ランダムフォレスト¶

決定木を組み合わせた ランダムフォレスト という手法は性能が高く、過学習に陥りにくく、スケーラビリティに優れている(並列実行が可能)という特徴があります。

アンサンブル学習とランダムフォレストとは¶

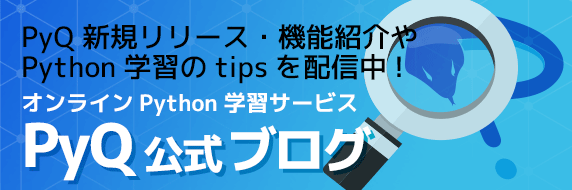

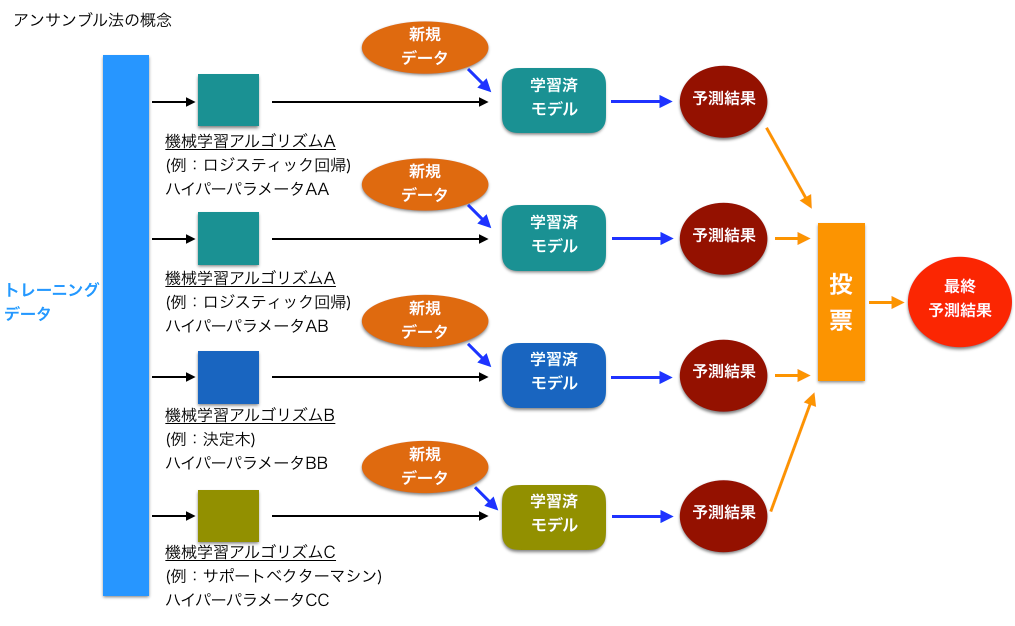

アンサンブル学習 とは複数のアルゴリズムを組み合わせて、より強い学習モデルを作ろうとする手法の総称です。

最も単純なアンサンブルは多数決です。複数のモデルに学習させた結果、多数決で分類を決定する手法です。 複数のモデルを使うことで過学習に陥りにくくなります。

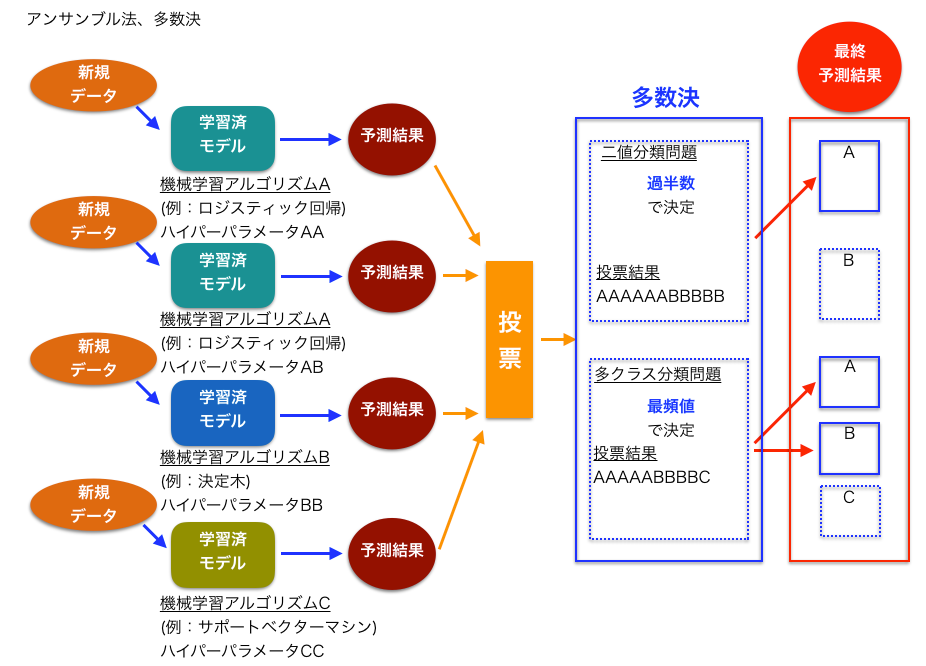

今回のランダムフォレストもアンサンブルの一種で、複数の決定木を学習させて多数決をとる手法です。

決定木の深さを単純に大きくすると過学習に陥りやすくなりますが、複数の決定木を学習させることで過学習を回避できます。

この RandomForestClassifier も他の分類器と同様に、 .fit(...) 、 .score(...) や .predict(...) メソッドが使えます。

パラメーターには決定木の数などを指定できます

n_estimators: 多数決させる決定木の数max_depth: 1つ1つの決定木の最大の深さrandom_state: 乱数のシード値

他にも並列実行数 n_jobs など便利なパラメーターも指定できます。

詳しくは sklearn.ensemble.RandomForestClassifier を参照ください。